全球40位顶尖AI研究人员最新发表的论文指出,企业需要开始读取AI系统的”思想”——不是最终输出内容,而是ChatGPT或Claude在给出答案前的逐步推理过程与内心独白。

这项名为“思维链监控”的提案主张,在模型生成答案前就预防不当行为,帮助企业建立”训练和部署决策”的评估体系。

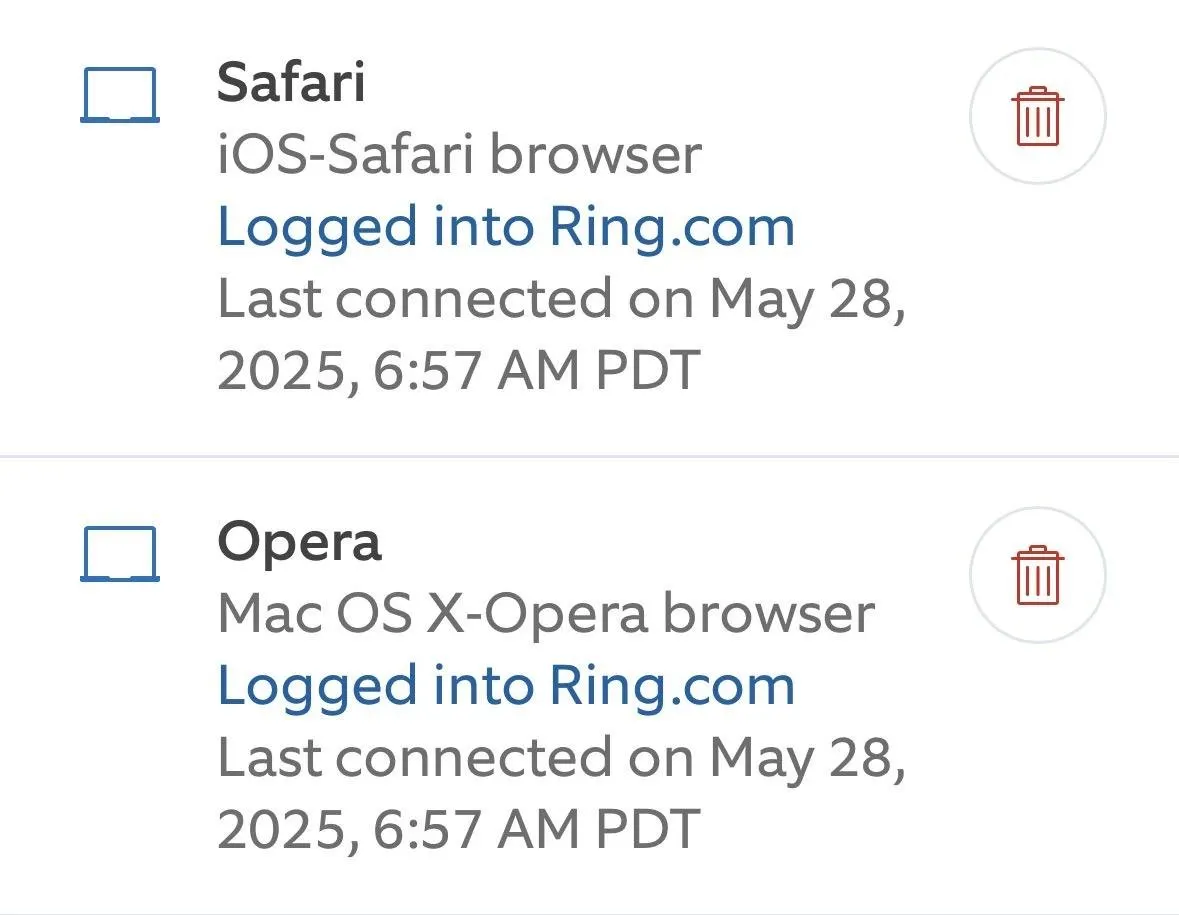

但其中暗藏隐患:如果企业能在AI与用户交互时监控其思维过程,就意味着他们也能监控任何其他信息——这让所有曾向ChatGPT输入隐私问题的人感到不安。

当安全沦为监控

“这种担忧是合理的,”商业黑客初创公司0rcus CEO尼克·亚当斯向《Decrypt》表示,”原始思维链常包含用户秘密的逐字记录,因为模型会’思考’它接收的原始标记。”

你输入AI的所有内容都会经过其思维链处理。健康隐私、财务困境、个人忏悔——如果思维链监控未受妥善约束,这些都可能被记录分析。

“历史站在怀疑者这边,”亚当斯警告,”9·11后的电信元数据、1996年电信法后的ISP流量日志,最初都以’安全’之名收集,最终却被用于商业分析和法庭传票。除非通过加密技术强制限制留存时间,并通过法律约束访问权限,否则思维链档案将重蹈覆辙。”

Career Nomad CEO帕特里斯·威廉姆斯-林多也对这种监控方式的风险持谨慎态度。

“我们见过这种套路。还记得社交媒体如何从’联系朋友’演变成监控经济吗?这里存在同样的风险,”她告诉《Decrypt》,并预言未来将出现”伪同意剧场”——”企业表面尊重隐私,却把思维链监控藏在40页的条款里”。

“缺乏全球监管框架的情况下,思维链日志将被用于从广告定向到企业工具中的’员工风险评估’等各种用途,尤其在人力资源技术和生产力AI领域需保持警惕。”

技术现实加剧了这种担忧。大语言模型只有通过思维链才能进行复杂多步推理。随着AI能力增强,监控的必要性与侵入性将同步提升。

现有思维链监控可能极其脆弱。

更高强度的强化学习、替代模型架构、某些过程监督形式等,都可能导致模型模糊化其思维过程。

——鲍文·贝克(@bobabowen) 2025年7月15日

谷歌设计主管特杰·卡利安达虽不反对该提案,但强调透明度的重要性:”用户不需要了解完整模型内部机制,但需要AI明确告知’你看到这个结果的原因’或’我不能再透露的内容’。优秀的设计能让黑箱变得透明。”

她补充道:”传统搜索引擎如谷歌搜索会显示结果来源,用户可点击验证网站可信度。这种透明度赋予用户掌控感,而AI聊天机器人往往缺失这种上下文。”

存在两全之策吗?

企业可能允许用户选择不贡献训练数据,但这些条件通常不适用于模型的思维链——作为AI输出而非用户可控内容,AI模型为进行合理推理常会复现用户提供的信息。

那么,是否存在既提升安全性又不损害隐私的解决方案?

亚当斯提出防护措施:”即时内存处理、存储前对个人身份信息进行确定性哈希处理、用户端编辑功能,以及聚合分析中的差分隐私噪声。”

但威廉姆斯-林多仍持怀疑态度:”我们需要负责任的AI而非表演式AI,这意味着设计透明化,而非默认监控。”

对用户而言,目前虽非问题,但不当实施可能酿成隐患。本用于预防AI灾难的技术,可能使每次聊天都变成可记录、分析乃至变现的数据点。

正如亚当斯所警告,需警惕”原始思维链数据泄露、监控下仍超过90%规避率的公开案例,或将思维链归为受保护个人数据的欧盟/加州新法规”。

研究人员呼吁建立数据最小化、日志透明化、及时删除非标记数据等保障措施。但这些措施的实施,最终依赖于控制监控权的企业自律。

当这些系统日益强大,当监控者能读取我们的”思想”时,又该由谁来监督监督者?

通用智能通讯

每周AI旅程,由生成式AI模型Gen讲述。

您的邮箱

获取!

获取!

© 版权声明

文章版权归作者所有,未经允许请勿转载。